پیمان ایلان ماسک و بزرگان تکنولوژی برای عدم توسعه هوش مصنوعی مرگبار

به تازگی بزرگان صنعت تکنولوژی پیمانی امضا کردند تا از توسعهی هوش مصنوعی مرگبار جلوگیری کنند. بدین ترتیب ایلان ماسک و سه نفر از بنیانگذاران DeepMind (زیر شاخه هوش مصنوعی گوگل) متعهد شدند که سلاحهای خودکار ...

به تازگی بزرگان صنعت تکنولوژی پیمانی امضا کردند تا از توسعهی هوش مصنوعی مرگبار جلوگیری کنند. بدین ترتیب ایلان ماسک و سه نفر از بنیانگذاران DeepMind (زیر شاخه هوش مصنوعی گوگل) متعهد شدند که سلاحهای خودکار مرگبار نخواهند ساخت.

این پیمان در واقع جدیدترین اقدام محققان و مدیرانی است که با هم متحد شده و مخالف توسعه تکنولوژهای نظامی این چنینی هستند.

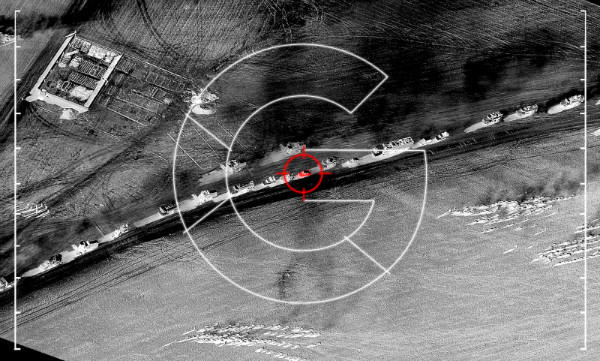

بر اساس این تعهدنامه سلاحهایی که با استفاده از هوش مصنوعی و بدون دخالت انسان، هدفهای خود را انتخاب کرده و به آنها شلیک میکنند، تهدیدی جدی برای اخلاقیات انسانی به شمار میروند.

بزرگان صنعت تکنولوژی معتقدند که یک ماشین هیچگاه نباید برای پایان دادن به جان انسانی دیگر تصمیم بگیرد و در صورت بکار گرفته شدن چنین سیستمی، خطرات و بی ثباتیهای زیادی برای ساکنین تمامی کشورها به وجود خواهد آمد.

این تعهدنامه توسط شرکت Future of Life (آینده زندگی) که موسسهای تحقیقاتی در زمینه کاهش خطر هوش مصنوعی برای انسانیت فعالیت میکند، تهیه گشته و اخیراً در کنفرانس مشترک بین المللی هوش مصنوعی سال ۲۰۱۸ استکهلم نیز منتشر شده است.

موسسه یاد شده پیش از این نیز نامههایی در این زمینه تنظیم کرده بود تا آئین نامههای جدیدی برای تولید و توسعه سلاحهای خودکار مرگبار تنظیم گردد.

«مکس تگمارک» استاد فیزیک دانشگاه MIT و یکی از امضاکنندگان این تعهدنامه در بیانیهای راجع به تکنولوژی هوش مصنوعی مرگبار میگوید:

«رهبران صنعت تکنولوژی موضع خود را از حرف زدن به عمل کردن تغییر دادهاند و به صورت علنی اعلام میکنند با خواستهی سیاستمدارن مخالفند و محدودیتهای زیادی در توسعه هوش مصنوعی نظامی در پیش خواهند گرفت. بدین دلیل که اسلحههایی که به صورت خودکار جان انسانها را میگیرند منزجر کننده هستند و باید همانند سلاحهای شیمیایی کنار گذاشته شوند.»

تماشا کنید:وقتی گوگل اسیستنت تیراندازی می کند؛ چه کسی مسئول است؟

دیدگاهها و نظرات خود را بنویسید

برای گفتگو با کاربران ثبت نام کنید یا وارد حساب کاربری خود شوید.

به نظرم متاسفانه نمی شه اینطوری جلوشو گرفت

شرکت A یک هوش مصنوعی مثلا خوب را توسعه میده، در نهایت شرکت B میاد ازش در کارهای خلاف اخلاقی (جنگ) استفاده می کنه

بعد می فهمی که خود اون شرکت A، زیر مجموعه شرکت B بوده از اول ?

یادمه نوجوون بودم یک سلاح الکترونیکی ساختم که از راه دور کنترل میشد و گلوله شلیک میکرد البته ضعیف . اون موقع ملت چاقو لاغر و لولیک بولیک نگاه میکردن

ایلان ماسک فکر کرده در کشور خودش در صدر توسعه تکنولوژی قرار داره ولی اصلا اینطور نیست که با این پیمانها به اصطلاح از توسعه هوش مصنوعی مرگبار بتونه جلوگیری کنه . بهترین دانشمندان و متخصصان پشت پرده در اختیار دولتها هستن